11月5日报道,近日,腾讯微信AI团队发布的一篇论文在海外AI圈引发广泛关注。论文提出了一种名为“连续自回归语言模型(CALM)”的新颖架构。与传统Transformer相比,CALM直接将训练大模型所用的计算量减少了44%,推理时的计算量也减少了34%。

CALM的核心逻辑是,将连续的K个token压缩成一个语义向量,并在生成时直接预测“下一个向量”而非“下一个token”。假设K=4,那么原本需要逐步生成4次的内容,现在只需1步即可完成,使其能在一次生成中输出更多信息,大幅提升效率。

这项研究的相关讨论在社交媒体平台X的阅读量累计已经超过100万次,在评论区引起热议。

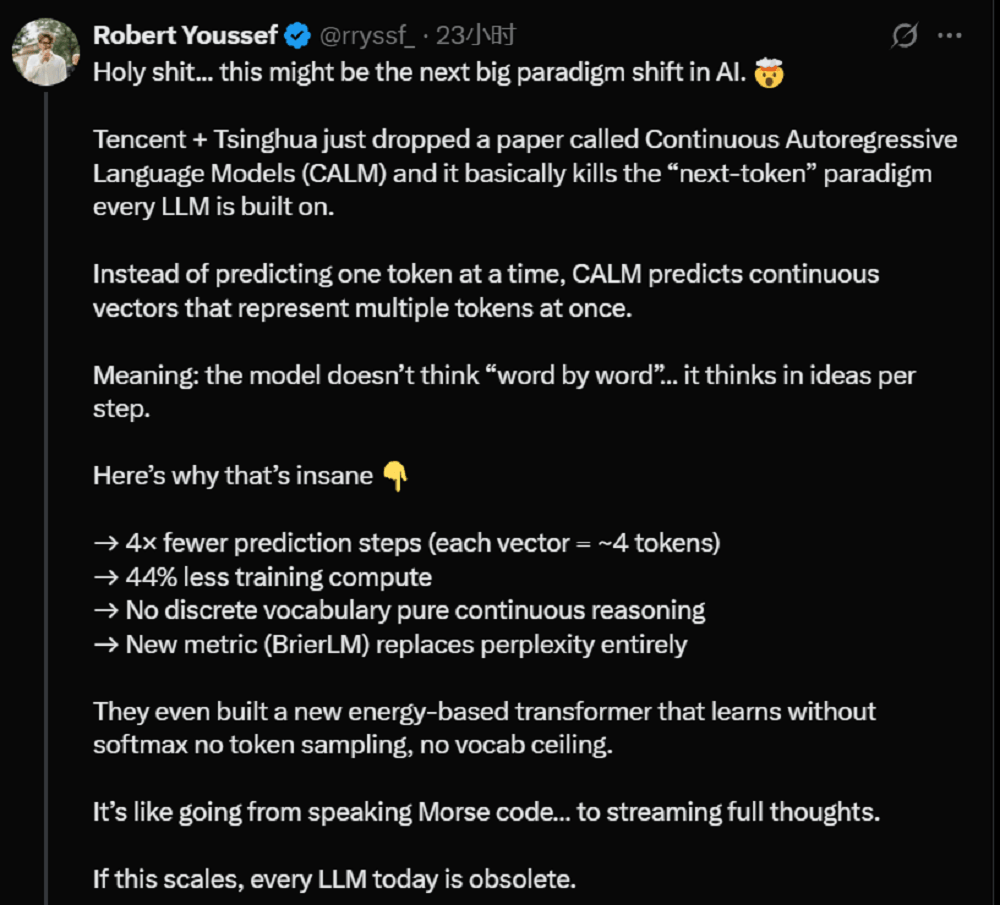

提示词分享网站godofprompt.ai的联合创始人Robert Youssef认为,CALM或许就是AI领域下一次大的范式转变,彻底颠覆了所有大语言模型赖以构建的“下一个token预测”范式,让大模型不再逐字思考,而是以想法为单位进行思考,简直不可思议。这一方法如果能成功扩展,那么现有的LLM都将过时。

还有多位网友认为CALM提出的概念值得探讨,但关键是需要在更大规模的Scaling过程中获得验证。

然而,也有人质疑CALM的前景。这位网友称,CALM只是杨立昆的一个老旧想法,训练不稳定,基础很薄弱,且无法扩展,是一种“有缺陷的方案”。

CALM论文的作者均在微信AI团队任职,第一作者邵晨泽曾在中科院计算所智能信息处理实验室完成博士学业。这篇论文的其他作者包括Darren Li、Fandong Meng和Jie Zhou,其中,Darren Li是清华大学求真学院的在读学生。为方便后续研究,研究使用的预训练Autoencoder以及CALM的检查点均可供下载。