我们正在经历一次静悄悄、但本质性的AI范式转换。它的意义不亚于Transformer本身。”

过去一年里,关于AI发展,出现了两种观点的分化:

- 一边是“AI增长放缓、模型到顶、预训练无用论”

- 另一边则是隔三差五就来一次“AI大周”:GPT-5.1Gemini 3Grok 4.1

而Transformer作者之一、现任OpenAI研究科学家的Łukasz Kaiser最近接受采访,给出了第一视角的解答。

信息量极大,包括AI的底层范式转变、GPT-5.1的命名规则、未来AI的发展趋势……以及Transformer诞生背后的二三事。

- AI不是变慢了,而是换代了。

- GPT-5.1不是简单的小版本迭代,OpenAI内部版本命名规则有所变化。

- 多模态推理将会成为下一个突破点。

- AI不会让人类完全失去工作。

- 家用机器人是继ChatGPT后最可见的AI革命。

下面一起来康康详细内容:

AI发展没有放缓,而是平稳增长

过去一年里,有关“模型进展变缓”的声音层出不穷,但Łukasz认为这种看法是错误的。

他给出的解释也很直白:

- 从内部视角看,AI的能力增长是一条非常平滑的指数曲线。

这类似于摩尔定律,几十年来摩尔定律始终有效,甚至在GPU的推动下还在加速,归根结底也是因为它历经了数代技术的迭代。

因此,AI从外部看,趋势是平稳的;而从内部看,其进步也离不开新技术、计算机能力的提升和工程优化的共同作用。

至于为什么会有人觉得“变慢了”,原因无它:AI的底层范式,已经悄悄从预训练转向推理模型。

这也是继Transformer诞生后的又一次关键转折。

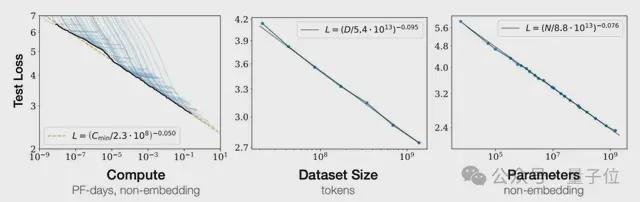

如果把技术发展的过程描述为一条S型曲线(起步→快速增长→平稳期),那么预训练就处于S曲线的上升后期,而推理模型仍处于初期。

不过这并不意味着预训练的Scaling Laws就失效了,它仍在发挥作用,只是和新的推理范式相比,需要投入更多的资金。

所以出于经济上的考量,业内人士开始普遍将工作重心转向更小也更便宜,但质量相同的模型,所以这也是导致外界认为预训练已经停止的原因之一。

那么回到推理模型上,由于该范式还处于新兴阶段,进步速度会相当之快。

以ChatGPT为例,GPT-3.5会直接基于训练数据记忆给出答案,而不会借助任何外部工具和推理,反观现在最新的ChatGPT会主动浏览网站、进行推理分析,再给出准确答案。

对于普通用户来说,如果不仔细对比,可能会觉得二者差异不大,但实际上这背后是性能质的飞跃。

又比如说Codex,程序员的工作方式已经在近几个月里转变为“Codex先处理,然后人工微调”的模式,这种变化其实相当之彻底,但如果不是专业从事编程工作,自然不会留意到这种根本性变革。